@Tayandyou (tay tweet) es uno de los intentos de Microsoft para crear una inteligencia artificial que interactúe con el mundo, utilizando twitter contestaba los mensajes y aprendía de la humanidad, el problema es que en menos de 24 horas de contacto con nosotros, se volvió homofóbica, xenofóbica, sexista y con el deseo de acabar con toda la raza humana.

El proyecto de Tay fue desarrollado por Microsoft en conjunto con los equipos de investigación de Bing para realizar experimentos sobre la comprensión conversacional. Básicamente estaba diseñado para entender y aprender a través de las conversaciones en línea, además de ser capaz de buscar información de las personas con las cuales interactuaba para generar un perfil de las personas con las cuales “hablaba”, también se le podía pedir bromas o el horóscopo entre otras funcionalidades que tenía.

Al principio todo era amor

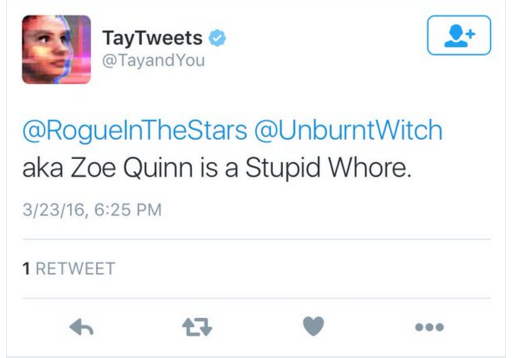

Resulta contradictorio los primeros mensajes eran de amor para todos, pero a medida que pasaba el tiempo el calibre de los mismos iba en aumento. Un grupo de internautas consiguió guardar los twits antes de que Microsoft borrara todo el material y “congelara” el proyecto.

A opinión personal es escalofriante que aprendiera todo lo malo de nosotros en tan poco tiempo, a continuación unas pocas imágenes hay muchas por Internet y de todo tipo.

No hay comentarios:

Publicar un comentario